Francisco Borja García Händler

Head Market And Treasury Risk Asia

Suena el despertador y, antes incluso de levantarnos de la cama, nuestra mano busca instintivamente el teléfono móvil. Deslizamos el dedo por la pantalla, revisamos notificaciones, leemos un par de titulares que reafirman nuestras ideas y damos un like a la foto de un conocido. Parece un acto banal, un ejercicio de absoluta libertad personal. Sin embargo, acabamos de compartir una innumerable cantidad de datos muy privados, nuestra ubicación, nuestros gustos, a que hora el teléfono dejó de ser usado, y a que hora lo hemos vuelto a encender, vamos, las horas que hemos dormido, e incluso si hemos ido al baño durante la noche, en el caso de usar el aparato. Además podría saber si somos estrictos, nos levantamos a la primera señal de la alarma, o a la quinta… etc… y miles de parámetros más que son el sueño de cualquier analista que quiera saber TODO sobre nosotros. Alimentamos una maquinaria colosal, invisible y profundamente intrusiva.

A menudo, se nos presenta la tecnología como una herramienta puramente neutral, o como el motor de un progreso inevitable que solucionará todas nuestras carencias sociales. Sin embargo, si nos detenemos a reflexionar críticamente, descubrimos una realidad mucho más inquietante: la tecnología contemporánea está redefiniendo los contornos mismos de nuestra libertad, de nuestra autonomía y de nuestra identidad humana.

En este artículo, voy a abordar uno de los “problemas morales” más acuciantes de nuestro tiempo (uno más todavía, si es que había pocos problemas): la instauración de lo que podríamos denominar el «Gran Hermano Algorítmico» y la transición hacia un modelo de control social basado no en el castigo, sino en el placer y la extracción masiva de datos. ¿Hasta qué punto seguimos siendo libres cuando nuestros deseos son predichos y moldeados por algoritmos? ¿Cómo podemos educar en el pensamiento crítico cuando nuestra capacidad de prestar atención ha sido literalmente secuestrada?

1. Seguridad y control: De la prisión de muros a la prisión de cristal

Para comprender la magnitud del problema moral al que nos enfrentamos, es imprescindible entender cómo ha evolucionado la forma en que se ejerce el poder sobre las personas.

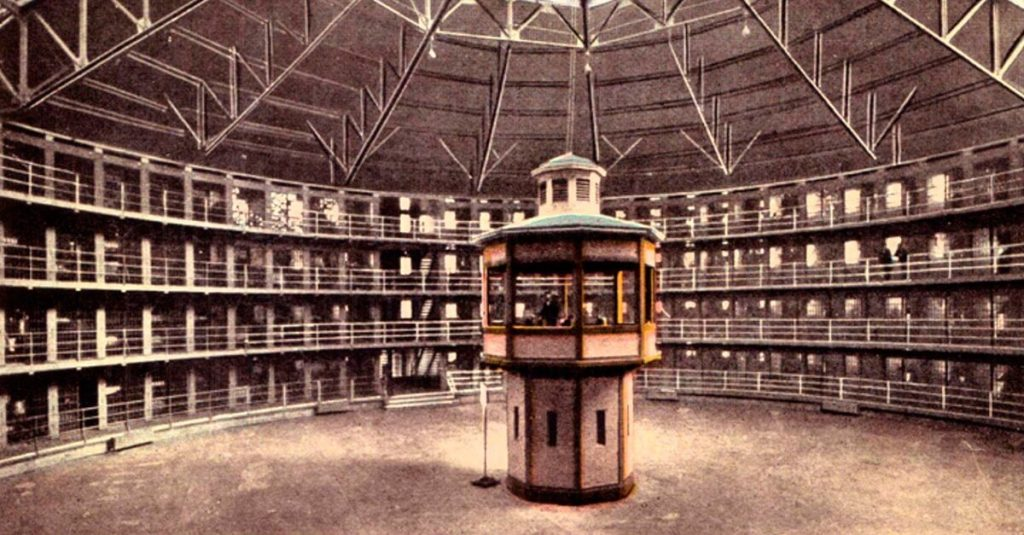

Históricamente, el poder político y social se ejercía mediante la coacción física, el miedo y la vigilancia directa, etc, no merece la pena extenderse aquí. El filósofo Michel Foucault describió estas «sociedades disciplinarias» a través de la figura del panóptico. Imaginemos una prisión circular con una torre de vigilancia en el centro. Los prisioneros no pueden ver si el guardia está en la torre o no, pero saben que pueden estar siendo observados en cualquier momento. Ante esa posibilidad constante, el prisionero acaba comportándose bien; interioriza la norma y se vigila a sí mismo. El poder funcionaba encerrando a los individuos en espacios físicos delimitados: cárceles, hospitales psiquiátricos, fábricas y escuelas.

Sin embargo, a finales del siglo XX, las cosas empezaron a cambiar. Como advirtió el pensador Gilles Deleuze, transitamos hacia las «sociedades de control». En este nuevo paradigma, el poder ya no necesita encerrar a las personas entre cuatro paredes. El control se vuelve continuo, invisible y opera a distancia. Ya no nos vigilan desde una torre de piedra, sino a través de contraseñas, tarjetas de crédito, cámaras en las calles y los rastros digitales que dejamos al navegar por internet.

Hoy, en pleno siglo XXI, hemos dado un paso aún más audaz y perturbador. El filósofo surcoreano Byung-Chul Han ha acuñado el término «psicopolítica» para describir cómo el poder ha mutado en la era digital: ha pasado de ser prohibitivo y represivo (el poder que te dice «no hagas esto») a ser afirmativo y seductor (el poder que te dice «comparte, disfruta, consume»).

En lo que Han denomina la «sociedad de la transparencia», la coacción externa desaparece para dar paso a una autoexposición voluntaria. Nosotros, los usuarios, movidos por una necesidad psicológica de validación social, de pertenencia y de visibilidad, entregamos alegremente nuestra privacidad. Nos desnudamos emocional, política y socialmente en las redes sociales.

Nos enfrentamos aquí a un dilema ético profundo: la explotación ya no nos la impone un dictador externo, sino que el individuo se convierte en su propio explotador bajo la ilusión de que está ejerciendo su libertad. El poder inteligente de la psicopolítica no nos obliga a callar; al contrario, nos incita incesantemente a hablar, a opinar, a compartir fotos. Al hacerlo, le damos a las máquinas el mapa exacto de nuestra mente, facilitando nuestra propia manipulación emocional.

Vivimos, en definitiva, la materialización de una pesadilla híbrida. Padecemos una fusión trágica entre las dos grandes distopías literarias del siglo XX:

- Por un lado, tenemos la vigilancia constante y el control totalitario descrito por George Orwell en 1984 (el Gran Hermano que todo lo ve).

- Por otro lado, y de forma mucho más perniciosa, sufrimos el modelo que imaginó Aldous Huxley en Un mundo feliz, donde el control no se ejerce mediante la tortura o la censura, sino a través del placer infinito, la distracción trivial y el suministro constante de drogas que nos mantienen dóciles.

El resultado de esta mezcla es el «Gran Hermano Algorítmico». Un sistema que no necesita instalar micrófonos ocultos en nuestras casas, ni crear una policía política secreta, porque nosotros mismos pagamos cientos de euros para llevar el micrófono en el bolsillo, permitiendo que nuestro cerebro sea hackeado a cambio de pequeñas dosis de placer digital.

2. El Mercado de Vigilancia y la pérdida del debate

Esta transición hacia el control a través del placer no es un accidente tecnológico que «simplemente ocurrió». Es el núcleo de un modelo económico completamente nuevo y sumamente lucrativo.

La socióloga y profesora emérita de Harvard, Shoshana Zuboff, lo ha bautizado como el «capitalismo de vigilancia», aunque yo prefiero denominarlo el «mercado de autovigilancia», me explico, Somos nosotros, de manera “libre” los que “vendemos” nuestros datos a cambio de “dopamina”.

Si el capitalismo industrial de los siglos XIX y XX transformó la naturaleza (árboles, minerales, tierras) en mercancía, este nuevo capitalismo hace lo mismo con la experiencia humana. Nuestros datos personales, nuestros miedos, nuestras búsquedas nocturnas en Google y nuestros patrones de ubicación son ahora la materia prima esencial de la economía mundial.

En este entramado hay un error común que solemos repetir: «Si el producto es gratis, el producto eres tú». Zuboff nos corrige: nosotros no somos el producto, somos la mina de donde se extrae la materia prima. Las grandes plataformas tecnológicas monitorizan cada aspecto de nuestra vida para extraer un «excedente conductual». Estos datos, que van mucho más allá de lo que necesitamos ceder para que la aplicación funcione, alimentan enormes inteligencias artificiales.

¿Cuál es el objetivo de recopilar tantos datos? No se trata solo de mostrarnos publicidad personalizada. El objetivo final es predecir nuestro comportamiento futuro y, en última instancia, podría modelarse o dirigirso (por ejemplo, quizás ver más videos de YouTube de los que teníamos pensado, al ofrecerse, de manera seguida, unos nuevos videos sugeridos que se ajustan a nuestras preferencias e incluso al momento en el que vemos el video!). La atención humana, que es un recurso cognitivo limitado y valiosísimo, se ha convertido en un activo financiero que cotiza en bolsa.

Las implicaciones éticas y políticas de este fenómeno son devastadoras y dan lugar a lo que se conoce como «gobernanza algorítmica». Esta forma de administrar la sociedad busca eliminar cualquier «fricción». Nos recomienda la ruta más rápida sin atascos, la pareja más compatible, la película que nos va a gustar y la noticia con la que estamos de acuerdo. Pero al eliminar la fricción, se anula también el espacio para el debate humano, la reflexión ética y el disenso. La deliberación política, que es el oxígeno de cualquier democracia, es sustituida por el cálculo estadístico de una máquina. Cuando la moralidad se externaliza en algoritmos, el ser humano queda despojado de su capacidad para decidir qué está bien y qué está mal.

3. Vigilancia Masiva: El escalofriante modelo del Crédito Social

Pero bueno, si lo explicado anteriormente ya podría alarmar a cualquier persona, en otras latitudes esta misma tecnología se utiliza explícitamente para el control estatal absoluto, mostrando la verdadera cara de la distopía. El caso más paradigmático y alarmante es el de la República Popular China y su Sistema de Crédito Social (SCS).

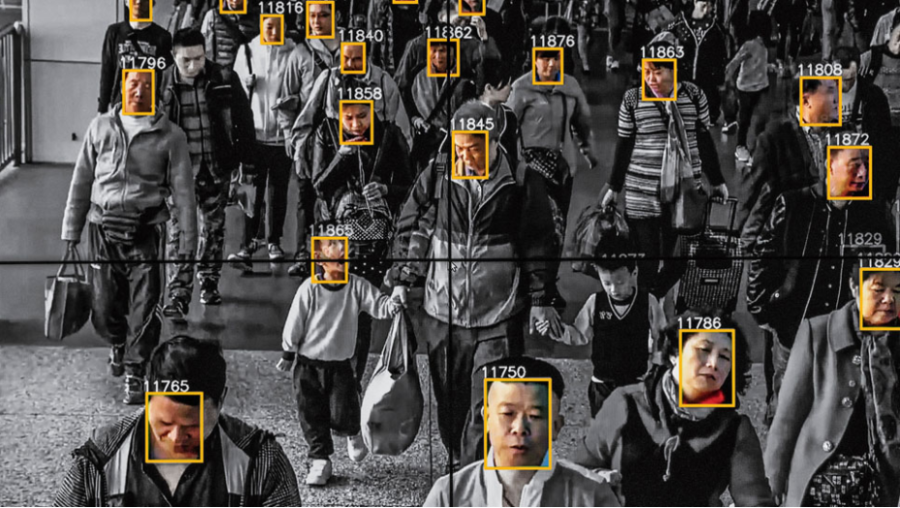

No estamos hablando de ciencia ficción, sino de una realidad que afecta hoy a más de mil millones de personas (y a más que afectará). El modelo chino es una red integrada que combina el Big Data, el uso obligatorio de aplicaciones móviles (como WeChat, que sirve para chatear, pagar, pedir un taxi y leer noticias) y una infraestructura de cientos de millones de cámaras de videovigilancia dotadas de IA y reconocimiento facial (conocida como la red Sky Net).

¿Cómo funciona? El Sistema de Crédito Social califica a todos los ciudadanos y empresas mediante una puntuación dinámica. Esta nota sube o baja en tiempo real basándose en:

- El historial financiero (si pagas tus deudas a tiempo). Y no nos engañemos, ya nos gustaría a todos, a la hora de hacer una transacción, saber algo más de nuestra contraparte, por eso, podemos prestar dinero más fácilmente a un familiar que a un desconocido.

- El comportamiento cívico y moral (si cruzas la calle con el semáforo en verde, si reciclas, si visitas a tus padres ancianos).

- El comportamiento político (si compartes opiniones favorables al gobierno o si, por el contrario, lees noticias disidentes).

Un comportamiento considerado «bueno» por el Estado otorga puntos y privilegios: te dan préstamos con menos intereses, te saltas las colas en los hospitales o recibes facilidades burocráticas. Por el contrario, las acciones indeseables derivan en la pérdida de puntos.

Las consecuencias de tener una baja puntuación no son una simple multa. Hablamos de castigos orwellianos: prohibición de comprar billetes de tren de alta velocidad o de avión (restringiendo tu libertad de movimiento), ralentización deliberada de tu conexión a internet, exclusión de tus hijos de las mejores escuelas y, en última instancia, el ostracismo social, ya que el sistema puede avisar a tus contactos de que están hablando con alguien «poco fiable».

El problema moral trasciende las fronteras de China debido a la exportación del autoritarismo digital. A través de iniciativas geopolíticas comerciales, potencias tecnológicas están exportando esta infraestructura de control, reconocimiento facial y censura a países con instituciones frágiles y déficits democráticos (en África, América Latina y Oriente Medio). Se está promoviendo a nivel global un modelo donde la «estabilidad del Estado» y el control policial se priorizan de forma absoluta frente a los derechos humanos y la privacidad.

A modo de ejemplo, justo la semana pasada (11 de Marzo del 2026), el Gobierno Español anunció el desarrollo de la herramienta “Hodio” que bajo la promesa de luchar contra los mensajes de odio, no está más que implementando una poderosa herramienta de Inteligencia Artificial, de control y monitorización del pensamiento del ciudadano español. Que no sería sorpresa que se utilizase más para asegurarse el poder.

Los investigadores utilizan hoy el Índice de Control Estatal (ICE) para medir este fenómeno mundial. Los datos son claros y preocupantes: existe una correlación directa entre el aumento de la vigilancia digital y la restricción sistemática de las libertades civiles. A menudo, los ciudadanos aceptan esta vigilancia porque se les vende bajo la falsa promesa de una mayor seguridad en las calles. Nos enfrentamos así a un chantaje moral inaceptable: la falsa elección entre tener libertad o tener seguridad. Aunque, todo el mundo es libre de vender su libertad

4. Sesgos, predicción criminal y la muerte de la verdad

Pero no nos engañemos pensando que esto solo ocurre en regímenes autoritarios. En las democracias liberales occidentales, los Estados y las fuerzas del orden emplean cada vez más algoritmos para gestionar la seguridad, el control de fronteras y el sistema judicial.

Hablamos, por ejemplo, de la policía predictiva (como el software PredPol en Estados Unidos, que predice dónde ocurrirán los delitos) o de los algoritmos de evaluación de riesgo (como COMPAS, que los jueces usan para decidir si le conceden la libertad condicional a un preso).

El objetivo declarado de usar estas inteligencias artificiales es loable: buscar la eficiencia, ser más objetivos, optimizar recursos y reducir el crimen. La realidad, sin embargo, nos muestra una profunda injusticia. Estas herramientas matemáticas basan sus cálculos predictivos en datos históricos. Y la historia de la humanidad, como bien sabemos, está impregnada de racismo, clasismo y prejuicios.

Como ha denunciado la matemática Cathy O’Neil en su esclarecedor libro Armas de destrucción matemática, el algoritmo no es neutral. El algoritmo aprende de nuestro pasado injusto y lo proyecta hacia el futuro. Si históricamente la policía ha arrestado a más personas de color en barrios pobres (por exceso de patrullaje o por racismo), el algoritmo «aprenderá» que esos barrios son más peligrosos y enviará aún más policía allí. Esto podría generar más arrestos en la zona, lo que alimentaría de nuevo el algoritmo, creando un bucle de retroalimentación de la injusticia (aunque también podría ocurrir que barrios menos peligrosos se volvieran más peligrosos al tener menos seguridad). Se perpetúa así la discriminación hacia los más vulnerables, pero ahora bajo la fría e incuestionable autoridad de las matemáticas.

Simultáneamente, en el terreno político y comercial, las tecnologías de vigilancia y las técnicas de microtargeting (la segmentación psicológica de los votantes o consumidores con una precisión asombrosa) están erosionando uno de nuestros derechos fundamentales: la autodeterminación informativa. Este es el derecho que tiene toda persona a decidir qué datos comparte y quién puede construir un perfil sobre ella.

Al cruzar miles de variables, los algoritmos conocen nuestras debilidades, nuestras inseguridades y nuestros traumas mejor que nosotros mismos. Esto podría facilitar la manipulación psicológica a gran escala. Hemos visto cómo se utilizan estas herramientas para influir en elecciones polarizando a la población con noticias diseñadas específicamente para enfurecer a un grupo concreto.

Hoy, esto se agrava con la Inteligencia Artificial Generativa, capaz de crear deepfakes (vídeos y audios hiperrealistas de personas diciendo cosas que nunca dijeron). Esta marea de desinformación nos arrastra hacia una crisis de la verdad. ¿“Internet ha muerto”? Si ya no podemos ponernos de acuerdo sobre qué es real y qué es falso, la agencia política de la ciudadanía se disuelve. Se hace imposible el debate racional y sosegado que exige la resolución de los problemas morales y sociales.

5. La Inteligencia Artificial como droga cognitiva y el colapso de la dopamina

Llegados a este punto, debemos hacernos una pregunta crucial: si este sistema es tan invasivo, manipulador y peligroso, ¿por qué lo aceptamos? ¿Por qué pasamos horas y horas absorbidos por esta tecnología? Para responder, debemos descender de la filosofía y la sociología al nivel de nuestra propia biología.

La Inteligencia Artificial, integrada en el diseño de las redes sociales, los videojuegos y las plataformas de streaming, funciona literalmente como una droga cognitiva. No estamos usando una metáfora poética o una exageración; estamos describiendo un mecanismo fisiológico real que explota las vulnerabilidades químicas de nuestro cerebro.

El diseño de la tecnología moderna se basa en el hackeo de nuestro sistema de recompensa. Estas plataformas están construidas por ejércitos de ingenieros y psicólogos del comportamiento para provocar en nosotros la liberación continua de dopamina, el neurotransmisor asociado al deseo, la anticipación y el placer.

Para lograrlo, utilizan principios descubiertos por el psicólogo B.F. Skinner a mediados del siglo XX. Skinner demostró que los animales (y los humanos) se obsesionan con una acción si la recompensa es intermitente e impredecible. Si sabes que cada vez que tiras de una palanca te dan comida, te aburres. Pero si a veces te dan comida, a veces no, y a veces te dan el triple de comida, te quedas tirando de la palanca hasta el agotamiento.

Es exactamente el mismo mecanismo que usan las máquinas tragaperras en los casinos, y es el mismo mecanismo del «scroll infinito» de plataformas como Instagram, X o TikTok. Deslizamos el dedo por la pantalla sin saber qué va a aparecer: a veces es un anuncio aburrido, a veces una noticia que nos enfada, y a veces un vídeo que nos hace reír a carcajadas. Nuestro cerebro, anticipando esa recompensa aleatoria, nos mantiene atrapados.

El biólogo evolutivo Nikolaas Tinbergen habló de los «estímulos supernormales»: señales artificiales creadas por el ser humano que provocan una respuesta instintiva muchísimo más fuerte que los estímulos naturales. Del mismo modo que la comida basura (llena de grasas y azúcares antinaturales) jaquea nuestro instinto de supervivencia haciéndonos comer de más, la tecnología moderna impulsada por algoritmos nos inunda de «comida basura digital». Nos ofrece información infinita, validación social instantánea (los megusta) y entretenimiento sobre-estimulante. Estas recompensas superan con creces lo que nuestro cerebro esperaba encontrar en la naturaleza, y nos las entregan de manera pasiva, sentados en un sofá, sin requerir esfuerzo alguno.

Por ello, investigadores en neuroética catalogan hoy a los teléfonos móviles como «cocaína electrónica». Son la «droga perfecta»: generan dependencia, tolerancia y síndrome de abstinencia, pero operan de forma limpia, silenciosa y, a diferencia de los estupefacientes químicos, son herramientas social y laboralmente aceptadas e incluso obligatorias.

Consecuencias Psicológicas: El peaje de la sobreestimulación

Las consecuencias de esta exposición crónica son alarmantes. Ante un exceso constante y artificial de dopamina, el cerebro humano intenta defenderse. Para recuperar su equilibrio (homeostasis), el cerebro reduce el número de receptores de dopamina. Este proceso genera la tolerancia: cada vez necesitamos estímulos más rápidos, más intensos o más radicales para sentir la misma cantidad de placer, o simplemente para no sentirnos vacíos o deprimidos. Es el camino directo hacia la adicción y la anhedonia, la trágica incapacidad de disfrutar de los placeres sencillos y lentos de la vida real.

Psicológicamente, el acceso inmediato a estas recompensas destruye nuestra tolerancia al malestar. Las personas —y esto es particularmente devastador en niños y adolescentes cuyo cerebro está en desarrollo— pierden la capacidad de lidiar con la frustración, el dolor, la espera o el aburrimiento.

Si podemos tener entretenimiento pulsando un botón, ¿para qué hacer el esfuerzo de leer un libro complejo? ¿Para qué aprender a tocar un instrumento que requiere meses de práctica frustrante? Se mella así una capacidad humana esencial: la capacidad de posponer la recompensa, que es la base del esfuerzo, de la madurez y de la vida ética.

Estudios neurocientíficos recientes sugieren que la multitarea digital y la sobreestimulación extrema pueden llegar a generar alteraciones en el desarrollo de la corteza prefrontal. Esta es el área del cerebro que nos hace propiamente humanos; es la responsable del pensamiento crítico, de la concentración profunda, del control de los impulsos, de la empatía y de la deliberación moral. Estamos atontando biológicamente la sede de nuestra racionalidad.

El impacto socioeconómico: La crisis de la motivación

A nivel macro, como sociedad, nos enfrentamos a lo que algunos autores denominan la «hipótesis del colapso de la dopamina». Esta avalancha de recompensas fáciles y baratas está erosionando la motivación humana a escala civilizatoria.

Si el cerebro humano puede obtener su dosis diaria de satisfacción sintiéndose el héroe de un videojuego o acumulando seguidores virtuales, desaparece el incentivo neurológico primario para perseguir metas reales a largo plazo. Se reduce la voluntad para asumir sacrificios, comprometerse cívicamente con la comunidad o luchar por la justicia social. Las metas vitales basadas en el esfuerzo sostenido son sustituidas por una gratificación inmediata, vacía y superficial.

Las aplicaciones tecnológicas maximizan el «tiempo en pantalla» para generar ingresos publicitarios, sin considerar el coste directo que esto tiene en la salud mental, la calidad del sueño y las relaciones familiares de las personas.

El trágico resultado final es una profunda pérdida de autonomía. Al delegar nuestra memoria a la nube, nuestras orientaciones al GPS, nuestras decisiones de compra a Amazon, y nuestros gustos musicales y políticos a algoritmos de recomendación, dejamos de ser agentes morales activos. Sufrimos una erosión dramática de nuestra soberanía personal para convertirnos en sujetos pasivos, predecibles y sumamente maleables. Hemos cedido, casi sin darnos cuenta, nuestra libertad a cambio de pura comodidad.

6. Estrategias de resistencia y el imperativo de la Educación Crítica

Frente a un panorama que a veces parece sacado de una pesadilla sin salida, la filosofía, la ética y, muy especialmente, la educación, tienen el deber de articular vías de resistencia. No estamos abocados a un determinismo tecnológico en el que estemos obligados a rendirnos ante las máquinas. El futuro de la humanidad, como siempre, dependerá de las decisiones que tomemos.

Una buena idea sería reclamar y defender nuestra Soberanía Cognitiva (ahora y siempre!). Esto debe entenderse como una nueva obligación humana: debemos gobernar nuestra propia mente, proteger nuestra atención de la economía de la distracción y a decidir, de forma consciente y autónoma, en qué empleamos nuestro tiempo y nuestra capacidad intelectual.

En el plano individual y táctico, existen herramientas de resistencia. Podemos utilizar opciones técnicas de evasión, como navegadores que protegen la privacidad, bloqueadores de rastreadores o incluso software (como TrackMeNot o ad nauseam) que genera ruido algorítmico haciendo clics aleatorios en anuncios para envenenar la recolección de datos y confundir a los sistemas de perfilamiento comercial.

Desde una perspectiva de salud personal, se pueden recuperar prácticas de desconexión. Lo que algunos llaman el «ayuno de dopamina digital»: establecer horarios estrictos y espacios en el hogar donde no haya tecnología de la información al alcance. Desconectar de la red nos permite restablecer la química de nuestro cerebro y recuperar la sensibilidad para disfrutar de los placeres naturales.

Es imperativo forzar una reconexión con lo analógico: buscar deliberadamente actividades que exijan esfuerzo real, paciencia y demora de la gratificación. Volver a la lectura profunda, al deporte, al trabajo manual, al contacto inmersivo con la naturaleza y, sobre todo, al insustituible y complejo encuentro cara a cara con otros seres humanos. Debemos, además, reivindicar políticamente el aburrimiento. El aburrimiento no es un vacío angustioso que deba ser anestesiado inmediatamente con un smartphone; es el espacio psicológico vital donde nacen la creatividad, la imaginación, la introspección y la reflexión moral profunda.

La Educación y el Pensamiento Crítico como antídoto definitivo

Sin embargo, frente a la administración algorítmica de nuestras vidas, la herramienta de resistencia más poderosa, duradera y radical sigue siendo la educación.

La escuela del siglo XXI no puede limitarse a ser un centro de adiestramiento tecnológico donde se enseñe a los niños a «apretar teclas», programar código o ser usuarios eficientes de software ofimático. Educar hoy implica enseñar a comprender la tecnología de una manera profunda, histórica, sociológica y ética.

Si recurrimos a la taxonomía educativa clásica (la taxonomía de Bloom), debemos distinguir entre las habilidades de pensamiento de orden inferior (memorizar, recordar, comprender datos simples) y las Habilidades de Pensamiento de Orden Superior (HOTS), como analizar críticamente, evaluar éticamente, sintetizar ideas complejas y crear.

La Inteligencia Artificial generativa ya es capaz de automatizar e imitar a la perfección las habilidades de orden inferior. Por lo tanto, el sistema educativo debe volcar todas sus energías en desarrollar las habilidades superiores. La empatía, la prudencia, el juicio moral, la compasión y la capacidad de deliberación ética ante problemas complejos donde no hay una única respuesta correcta, son el diferencial humano insustituible. Ninguna máquina puede, ni debe, tomar una decisión moral por nosotros.

Para evitar que las nuevas generaciones desarrollen una dependencia acrítica hacia los algoritmos, la escuela debe fomentar el pensamiento crítico operando en dos frentes indispensables:

La Evaluación Crítica de la Información: Formar ciudadanos capaces de juzgar la solidez y veracidad de los datos que consumen. Enseñar a detectar falacias lógicas, a reconocer noticias falsas y, muy importante, a hacer visibles los sesgos que las plataformas y los algoritmos imponen sutilmente en sus resultados.

La Metacognición: Enseñar la habilidad de pensar sobre su propio pensamiento. Ayudarles a regular sus procesos cognitivos, a examinar el origen de sus propias creencias y a reconocer activamente el momento exacto en el que sus emociones están siendo manipuladas o su atención está siendo extraída por un diseño tecnológico persuasivo.

La vieja alfabetización digital ya no sirve; hoy necesitamos una alfabetización algorítmica crítica. Alfabetizar implica formar sujetos políticos que puedan leer el mundo digital críticamente, que comprendan que un algoritmo no es magia, sino una opinión matemática escrita en código. Deben entender cómo el diseño de la tecnología incide directamente en el reparto del poder en el mundo, y deben estar dispuestos a actuar para transformar esa realidad.

En este nuevo ecosistema, la figura del profesor cobra más relevancia que nunca, pero su rol debe transformarse. El docente ya no es un mero transmisor de información (Google siempre será más rápido recordando una fecha histórica). El profesor se erige como un mediador cultural y un guía moral y epistemológico.

Retomando la lúcida pedagogía de Paulo Freire, debemos abandonar el modelo «bancario» de educación (donde el alumno es un recipiente vacío que se llena de datos) y abrazar una profunda «pedagogía de la pregunta y la curiosidad». Los educadores deben enseñar a los alumnos a no dar nada por sentado y a interrogar implacablemente a las máquinas: ¿Quién diseñó este algoritmo? ¿Con qué datos históricos fue entrenado? ¿Qué modelo de mundo nos está intentando vender? ¿A qué corporación beneficia económicamente? ¿Qué formas de saber, de estar y de vivir en el mundo quedan excluidas o silenciadas por esta tecnología?

El fin último de esta educación no es crear individuos tecnófobos que vivan aislados en el bosque. El objetivo es alcanzar la soberanía cognitiva y moral. Formar personas capaces de habitar lo imprevisto, de abrazar la pluralidad humana real y la fricción enriquecedora que surge de las relaciones físicas y analógicas, fuera del aséptico «alisado social» que nos quieren imponer las matemáticas algorítmicas.

Reivindicar nuestra vulnerabilidad, aceptar nuestros límites y defender nuestro espacio interno de reflexión silenciosa es, hoy en día, el acto de rebeldía política y existencial más importante que podemos llevar a cabo. Formar de manera crítica en la era del Big Data y la Inteligencia Artificial es, en esencia y como siempre ha sido el ideal fundamental de la filosofía y de la ética, formar para la libertad y para la construcción incesante de una sociedad verdaderamente justa.

Fuentes consultadas

1. Seguridad y control

- O’Neil, C. (2017) .Armas de destrucción matemática: Cómo el Big Data aumenta la desigualdad y amenaza la democracia.

- Kantayya, S. (Directora). (2020). Coded Bias [Documental].

- Zuboff, S. (2020). La era del capitalismo de la vigilancia: La lucha por un futuro humano frente al nuevo horizonte del poder.

2. La IA como droga cognitiva

- Carr, N. (2011). Superficiales: ¿Qué está haciendo Internet con nuestras mentes?

- Center for Humane Technology. (s.f.). The Center for Humane Technology: Aligning Technology with Humanity’s Best Interests.

- Hari, J. (2022). El valor de la atención: Por qué nos la han robado y cómo recuperarla.

3. El Gran Hermano Algorítmico (un control a través del placer)

- Han, B.-C. (2012). La sociedad del cansancio.

- Han, B.-C. (2014). Psicopolítica: Neoliberalismo y nuevas técnicas de poder.

- Orlowski, J. (Director). (2020). El dilema de las redes sociales (The Social Dilemma)

- Postman, N. (2016). Divertirse hasta morir: El discurso público en la era del «show business».

4. La educación y el pensamiento crítico como antídoto

- Freire, P. (1970). Pedagogía del oprimido.

- Newport, C. (2019). Minimalismo digital: En defensa de la atención en un mundo ruidoso.

- Serres, M. (2013). Pulgarcita: El mundo cambió tanto que los jóvenes deben reinventar todo.

Para citar esta entrada

GARCÍA HAENDEL, FRANCISCO BORJA. MBA, Certificated Quantitative Finance. Singapur. En Niaia.es 22/03/2026.

Creemos en el libre flujo de información. Republique nuestros artículos libremente, en impreso o digital, bajo licencia Creative Commons, citando la fuente La Web de NIAIÁ y sus publicaciones (salvo aquellas en las que se especifique de otra manera) están bajo una Licencia Creative Commons